Słowo „komputer” pochodzi od łacińskiego słowa computare, czyli „obliczać”. Pierwotnie oznaczało kalkulator mechaniczny lub osobę, która wykonywała obliczenia (np. w firmach inżynieryjnych) - najpierw ręcznie, a następnie przy pomocy kalkulatora mechanicznego. Znaczna część obliczeń potrzebnych we wczesnych programach kosmicznych została wykonana przez ludzi (w większości przez kobiety).

Jak więc ludziom udało się dotrzeć tak daleko w rozwoju cyfrowym i stworzyć pierwszy komercyjny komputer (UNIVAC sprzedany w 1951 r.), następnie pierwszy komputer osobisty (IBM PC w 1981 r.) i graficzny interfejs systemu Windows 95?

Historia komputera: od algorytmów do pierwszego programu

Wraz z upływem czasu świat płynnie przeszedł z epoki industrialnej do epoki informacyjnej. Ale nie od razu Rzym zbudowano: współczesne komputery powstawały przez wiele dziesięcioleci z pomocą dziesiątek matematyków, doktorów i teoretyków.

IX wiek

Muhammad ibn Musa al-Chuwarizmi rozwija algorytmy

kładąc podwaliny pod informatykę i rozpoczynając historię powstania komputera.

1801 r.

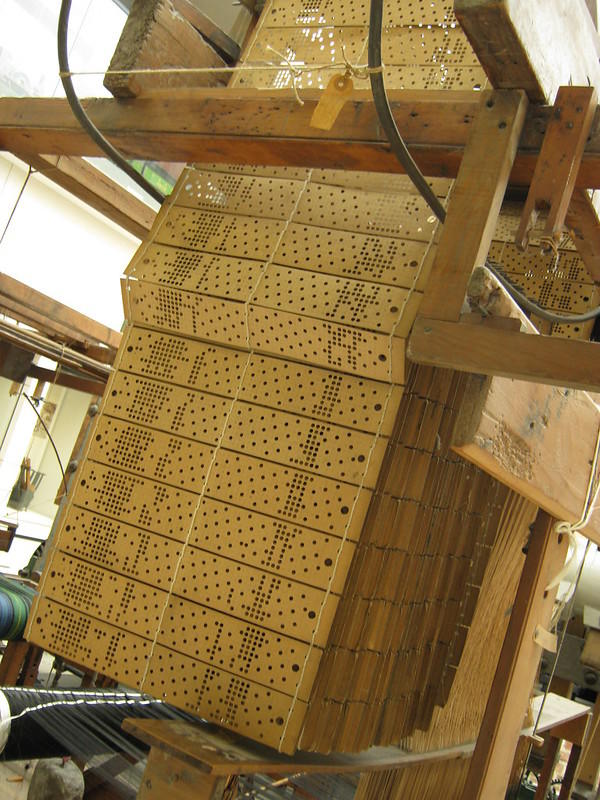

Joseph Marie Jacquard tworzy krosna z perforowanymi kartami

pierwszy programowalny mechanizm sterujący, prekursor kart perforowanych w komputerach.

1837 r.

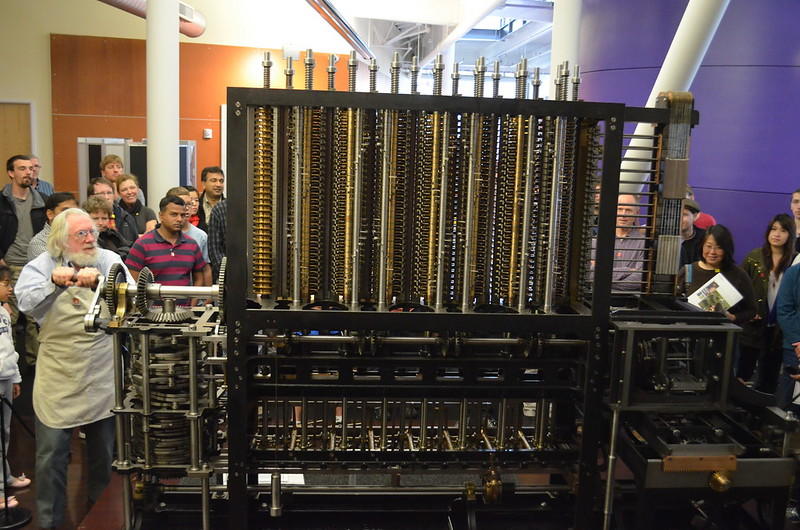

Charles Babbage projektuje Analityczną Maszynę

koncepcyjny pierwszy programowalny komputer mechaniczny.

1843 r.

Ada Lovelace pisze pierwszy program dla maszyny Babbage'a

staje się pierwszą programistką, jednocześnie przewidując uniwersalność obliczeń w ewolucji komputera.

1936 r.

Alan Turing opisuje maszynę Turinga

teoretyczny model komputera, który staje się podstawą informatyki teoretycznej oraz definiuje historię komputera.

1939–1945 r.

Alan Turing łamie kod Enigmy w Bletchley Park

- niemiecka maszyna szyfrująca z II wojny światowej; kluczowy wkład w zwycięstwo aliantów i narodziny kryptografii komputerowej.

1944 r.

Grace Hopper pracuje przy Harvard Mark I

- pierwszym wielozadaniowym elektromechanicznym komputerze, programowanym kartami perforowanymi.

1945 r.

John von Neumann opisuje architekturę von Neumanna

– standardowy model komputerów z oddzielną pamięcią na programy i dane, używany do dziś.

1947 r.

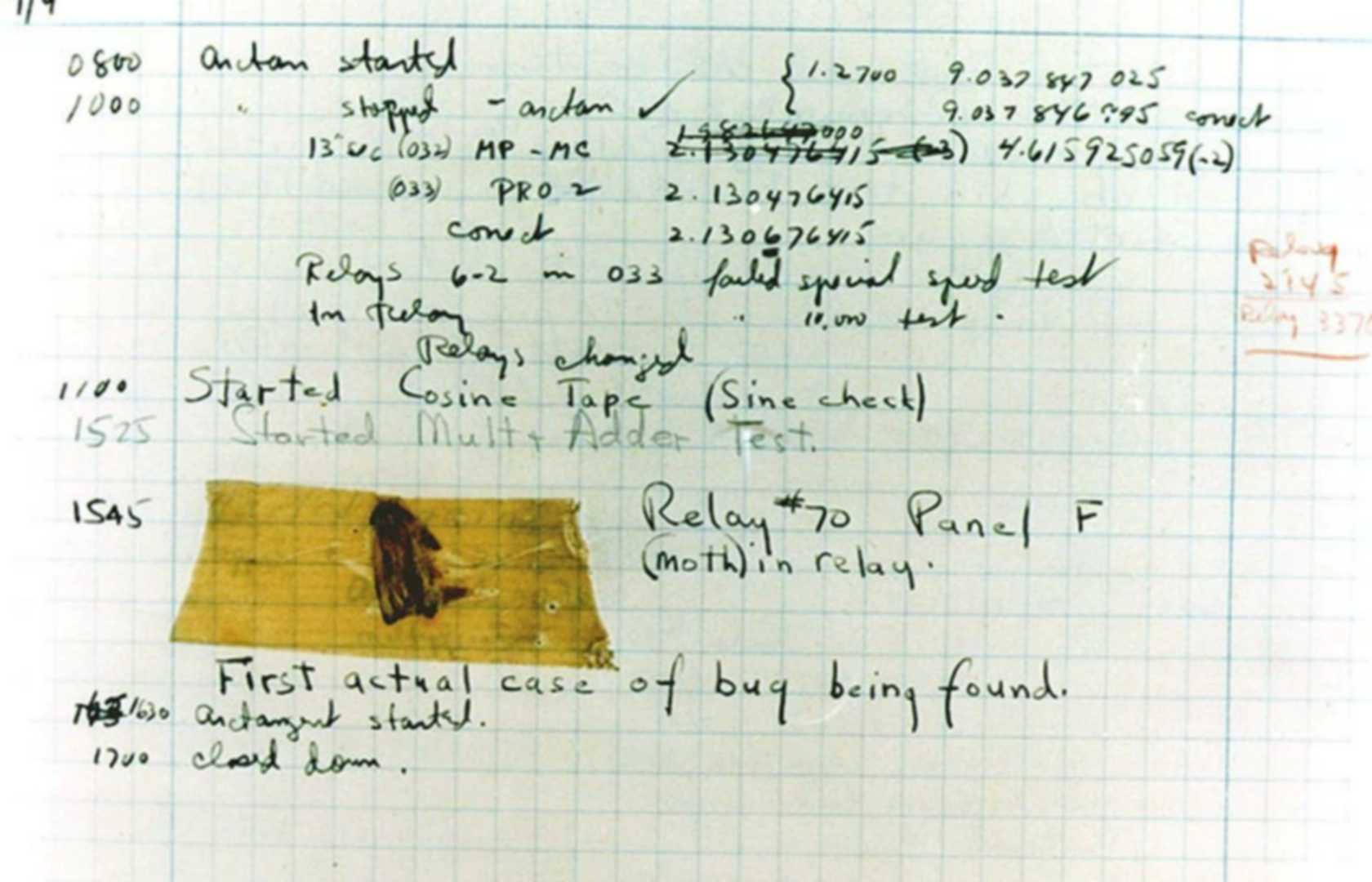

Grace Hopper znajduje pierwszy "computer bug"

dosłownie ćmę w obwodzie Harvard Mark II, co spopularyzowało termin "debugging".

1950 r.

AKAT-1 – pierwszy polski komputer elektroniczny

skonstruowany w Akademii Górniczo-Hutniczej w Krakowie przez zespół pod wodzą Lecha Zworskiego.

1970 r.

Rose Dieng-Kuntz jedną z pierwszych afrykańskich informatyczek

pracuje nad systemami eksperckimi, promując AI w Senegalu

1973 r.

Xerox PARC (Centrum Badawczym Palo Alto) rozwija GUI

- mysz komputerową i Ethernet – rewolucyjne innowacje, które zainspirowały nowoczesne komputery osobiste.

30.11.2022 r.

OpenAI udostępnia ChatGPT

pierwszy LLM dostępny szerokiemu gronu – przełom w historii komputera, demokratyzujący sztuczną inteligencję.

Znasz już tę historię? W takim razie zapoznaj się z naszym przewodnikiem po obsłudze komputerów dla początkujących.

Historia powstania komputera: Muhammad ibn Musa al-Chuwarizmi, ojciec algebry i algorytmów

Zacznijmy od Abu Jaffara al-Khwarizmi, zwanego też Mr. Algorithm - słowo „algorytm” jest w rzeczywistości latynizacją jego nazwiska. Rozwój komputerów jest w rzeczywistości bardzo ściśle powiązany z podstawowymi badaniami w matematyce. Szczególną rolę odegrały tu logika i algorytmy, które Al-Khwarizmi opracował w IX wieku naszej ery. Jemu zawdzięczamy również nasze nowoczesne cyfry arabskie (np. 1, 5, 10 w przeciwieństwie do łacińskich I, V, X).

Obliczanie to po prostu rozwiązanie konkretnego problemu przy użyciu określonego zestawu reguł. Algebra - i algorytmy - to nauka o operacjach potrzebnych do wykonania zadania. Są to operacje abstrakcyjne - na przykład dodanie do siebie dwóch liczb.

Aby przejść do konkretnej operacji, należy zakodować abstrakcyjną ideę w określonym języku. Służą do tego pojedyncze znaki reprezentujące określoną wartość. Jednocześnie rozmieszczenie tych znaków wpływa na niesioną przez nie informację, np. „1” ma inne znaczenie w liczbie „31”, a inne w liczbie „13”. Używamy również symboli kodujących pewne operacje, takich jak „+”, „-” i „=” (te jednak pojawiły się później).

Oto jak przechodzimy od „mam dwa jabłka, a mój przyjaciel daje mi jeszcze dwa” do "2 + 2 =?". Al-Khwarizmi nadał matematyce własny język „programowania”. Dzisiaj możesz z niego korzystać, np. biorąc udział w kursach programowania w Superprof lub opanowując popularne programy komputerowe (np. korepetycje excel).

Historia komputera w skrócie: Pierwszy program komputerowy

Pierwszy program, który wpłynął na działanie systemu stworzonego przez człowieka, nie był przeznaczony dla maszyny komputerowej, ale dla krosna mechanicznego. W 1801 roku słynny francuski tkacz Joseph Marie Jacquard wprowadził mechaniczne krosno. Można było je zaprogramować dla różnych wzorów używając kart dziurkowanych, tworzonych na specjalnych maszynach do pisania.

Położenie stempli zmieniało położenie części mechanicznych krosna, wybierało używane wahadłowce itp. - podobnie jak w przypadku nowoczesnych robotów przemysłowych. Jedna karta dziurkowana odpowiadała jednemu rzędowi tkanego motywu; karty zostały połączone w paski zawierające cały element (dywanik, wieszak na ścianę, materiał obiciowy itp.).

W późniejszym czasie Charles Babbage planował użyć kart dziurkowanych do swojego silnika analitycznego, a Harvard Mark I używał perforowanych rolek papieru do programowania.

Wynalezienie komputera: Ada Lovelace i maszyna analityczna Charlesa Babbage'a

Maszyny obliczeniowe miały uwolnić człowieka od rutynowych obliczeń. Ich zadaniem było błyskawiczne i autonomiczne przetwarzanie danych bez angażowania ludzkiego procesu myślenia krok po kroku.

Charles Babbage jest uważany za ojca nowoczesnych komputerów. Nigdy nie był w stanie ukończyć swojej maszyny różnicowej (maszyny obliczającej funkcje wielomianowe), ponieważ badania i testy trwały tak długo, że władze państwa zmniejszyły jego fundusze. Ostatecznie jej budowę dokończył syn wynalazcy. Dzisiaj maszynę można zobaczyć w London Science Museum. Co ciekawe, nadal działa!

Ada Lovelace, brytyjska matematyczka z XIX wieku, po raz pierwszy opublikowała swoją pracę w 1840 roku pod męskim nazwiskiem. Była autorką pierwszego programu komputerowego dla silnika analitycznego Charlesa Babbage'a. Mechanizm analityczny miał wykonywać wszelkie obliczenia wymagane przez człowieka: zarówno operacje symboliczne, jak i numeryczne.

Historia uruchamiania komputera

Dawniej, żeby włączyć komputer, nie wystarczyło kliknąć przycisk „power”. Pierwsze maszyny z lat 1950-1960 trzeba było uruchamiać ręcznie, przesuwając przełączniki i wprowadzając dane w postaci dziurkowanych kart albo taśmy papierowej. Cały proces był długi i skomplikowany. Z czasem pojawiły się programy startowe (tzw. bootloadery), które automatycznie wczytywały system operacyjny. Dzięki temu komputer szybciej się włączał i był łatwiejszy w obsłudze.

Włączając komputer w latach 1980-1990 widzieliśmy czarny ekran z migającym kursorem - tutaj trzeba było wpisać odpowiednią komendę. Dziś uruchamianie komputera jest już proste: wystarczy nacisnąć guzik, a system sam się wczytuje, pokazując kolorowe logo. To efekt wielu lat rozwoju technologii. Zobacz jakie akcesoria komputerowe sprawiają, że korzystanie z niej jest efektywne i przyjemne.

Rozwój komputerów: od kalkulatorów mechanicznych do oprogramowania

Człowiek, po tym jak nauczył się robić narzędzia, przeszedł do budowania maszyn. Obiekty te korzystały ze źródła zasilania i potrafiły samodzielnie wykonywać określone zadania. Tutaj warto wspomnieć, że maszyna mechaniczna nie może się sama modyfikować. Natomiast komputer może modyfikować własne oprogramowanie, stając się maszyną uniwersalną. Jest zdolny do pewnego rodzaju „mechanicznej inteligencji”.

Krótka historia komputera: Alan Turing i algorytmy uniwersalne

W 1936 roku Alan Turing napisał artykuł na temat informatyki. Udowodnił, że pewne elementarne obliczenia są uniwersalne. Oznacza to, że łącząc obliczenia na różne sposoby, można wykonać dowolny algorytm. W ten sposób otrzymamy uniwersalne i programowalne kalkulatory. To właśnie Alan Turing zapoczątkował Erę cyfrową.

Podczas drugiej wojny światowej, w latach 1939–1945, Niemcy szyfrowali wiadomości Enigmą. Było to urządzenie elektromechaniczne z wirnikami, które po naciśnięciu klawisza kierowały prąd przez obwód, zapalając zaszyfrowaną literę na lampce. Identyczna maszyna odbiorcy (z tym samym kluczem) deszyfrowała wiadomość, bo szyfr był symetryczny: powtórne zakodowanie dawało oryginał.

W 1932 r. polscy kryptolodzy, Marian Rejewski, Jerzy Różycki i Henryk Zygalski, pierwsi rozszyfrowali jej mechanizm dzięki matematyce i prototypowej "bomie kryptologicznej" – prekursorowi komputerów. Gdy Niemcy wzmocnili szyfr codziennymi zmianami kluczy, uniemożliwiając skalowalne łamanie, Polacy przekazali wiedzę i prototypy aliantom we wrześniu 1939 r.

W Bletchley Park Alan Turing ulepszył metodę, konstruując maszyny Bombe, które automatyzowały dekryptaż milionów wiadomości na bieżąco. To zespołowe osiągnięcie skróciło wojnę o lata, uratowało miliony żyć i zapoczątkowało erę programowalnych kryptomaszyn. Jeśli lubisz takie historie, przeczytaj nasz artykuł na temat najsłynniejszych programistów w historii!

Harvard Mark I

Po Adzie Lovelace, kolejną wyjątkową kobietą, która wniosła wkład do historii komputerów, była Grace Hopper. Pracowała ona nad pierwszym całkowicie automatycznym komputerem cyfrowym IBM o nazwie Harvard Mark I.

Co ciekawe, pewnego dnia w 1947 roku zepsuł się Mark II. Stwierdzono, że powodem była ćma, która utknęła w obwodzie przekaźnika. Ćma została ostrożnie usunięta i przyklejona do dziennika komputera z notatką: „Pierwszy faktyczny przypadek znalezienia błędu”. Dla wyjaśnienia, computer bug w języku angielskim oznacza błąd komputerowy, natomiast samo słowo bug oznacza owad.

Pierwsze komputery nie mogły być używane uniwersalnie, zamiast tego były programowane do obliczeń w określonej dziedzinie. Grace Hopper jako jedna z pierwszych broniła używania języka komputerowego opartego na angielskich słowach. Wynalazła kompilator, program, który przetłumaczył kod programowania algorytmu na język maszynowy.

Pierwsze komputery na świecie

Pierwsze komputery narodziły się około 1940 roku. W 1944 roku fizyk teoretyczny John von Neumann opisuje pierwszą architekturę komputerową, „architekturę von Neumanna”. Zatriumfowała ona nad innymi i jest obecnie stosowana w prawie wszystkich komputerach. Maszyna von Neumanna, IAS, została zbudowana w latach 1945-1951 przez inżynierów, podczas gdy kobiety programowały maszynę.

Do czasu, gdy Grace Hopper zmarła w 1992 roku, komputery stały się podstawowym narzędziem w gospodarstwach domowych. Nie zajmowały już całego pokoju i kosztowały tyle, co telewizor. Dodatkowo, komputery zrewolucjonizowały komunikację na poziomie globalnym wraz z rozwojem Internetu. Korzystanie z Internetu stało się codziennością miliardów ludzi na całym świecie.

Pierwsze komputery w Polsce

Pierwsze komputery w Polsce pojawiły się około 1950 roku. Nie wyglądały tak, jak dzisiejsze laptopy czy tablety: były ogromne, zajmowały całe pomieszczenia i składały się z setek lamp elektronowych. Pierwszym polskim komputerem był AKAT-1 (1958 r.), który pomagał w obliczeniach technicznych. Następnie powstała Odra, seria komputerów produkowanych we Wrocławiu, używana w wielu urzędach i zakładach pracy.

Choć były wielkie i wolne w porównaniu z dzisiejszymi maszynami, to właśnie one rozpoczęły w Polsce erę informatyki i pozwoliły rozwijać nowoczesną technologię. Korzystanie z niej w szkole i w pracy to teraz konieczność. Wyszukaj korepetycje informatyka na Superprof i opanuj niezbędne oprogramowania komputerowe już dziś.

Rewolucja komputerowa: od informacji o kodowaniu do cyber-opisów

Informacja to pojęcie abstrakcyjne, ale można zmierzyć wiadomość, bez względu na jej prawdziwą lub przypuszczalną wartość. Bez względu na to, czy jest prawdziwa czy fałszywa, zawiera określoną ilość informacji. Czym atom jest dla cząsteczki, tym bitem jest informacja: „tak/nie”, „prawda/fałsz”, „0/1”. Opisanie kogoś jako mężczyzny lub kobiety, młodego lub starego, małego lub wysokiego może jeszcze nie pozwolić nam na rozpoznanie tej osoby na ulicy, ale posiadamy już trzy informacje - trzy bity.

Obliczenia binarne po raz pierwszy pojawiły się w Europie około 1697 roku dzięki pracy Gottfrieda Wilhelma Leibniza.

Shannon zdefiniował kwantyfikację informacji w sposób matematyczny przy użyciu równań teorii prawdopodobieństwa opracowanych przez Kołmogorowa. Razem zmienili oblicze giełd cyfrowych.

Każdy obiekt (obraz, dźwięk, tekst, dane) posiada cyfrowe odbicie, które pozwala na zapamiętywanie, przesyłanie, odtwarzanie w nieskończoność i przetwarzanie w określony sposób tych danych przy użyciu różnego rodzaju algorytmów.

Metadane i sieć semantyczna

Rose Dieng-Kuntz pomogła zdefiniować sieć semantyczną. Określenie to oznacza serię technologii mających na celu udostępnienie i wykorzystanie informacji w sieci przez wszystkie programy - i ich użytkowników - przy użyciu systemu metadanych.

Np. jeśli wpiszesz w wyszukiwarkę „wypadek drogowy”, zostaną znalezione wszystkie wyniki, w których występują słowa „ruch drogowy” i „wypadek”. Ale jeśli w dokumencie jest mowa o „zderzeniu samochodu ciężarowego z rowerem” bez wzmianki o „wypadku drogowym”, nie pojawi się on na liście. Ideą sieci semantycznej jest znalezienie sposobu na jego pojawienie się. Sieć semantyczna to rozległy program, który jest nieustannie tworzony.

Świat cyfrowy dzisiaj: ewolucja interakcji pomiędzy użytkownikami a komputerami

Na początku XXI wieku obsługa komputerów przez zwykłych ludzi wciąż była na wczesnym etapie – myszy i okna dopiero wchodziły do powszechnego użytku. To Xerox PARC (Centrum Badawcze w Palo Alto) w 1973 r. wymyślił graficzny interfejs użytkownika (GUI), mysz komputerową i sieć Ethernet, gdy komputery osobiste PC jeszcze nie istniały. Te innowacje sprawiły, że obsługa maszyn stała się intuicyjna – zamiast wpisywać komendy, wystarczyło klikać ikony i okna. Dzięki Xeroxowi rozwój komputerów przyspieszył, ponieważ zainspirował on Apple i Microsoft do stworzenia systemów, które znamy dzisiaj.

1968 r.

Okna i mysz

Korzystając z wynalezienia kolorowego telewizora, Douglas Engelbart przedstawił wyświetlacz i okna, które można otwierać i zamykać za pomocą wskaźnika podłączonego do komputera: myszy.

1969-1983 r.

Klawiatura

Interfejs użytkownika był dość minimalny: klawiatura służyła do przekazywania informacji wyświetlanych na ekranie. W tym czasie komputery były zarezerwowane do użytku profesjonalnego na niektórych elitarnych domenach.

Od 1984 r.

WYSIWYG

po różnych postępach technologicznych, ważne stały się przyjazne dla użytkownika interfejsy. Informacje wyświetlane na ekranie to WYSIWYG (ang. What You See Is What You Get), wyrażenie spopularyzowane przez Apple dzięki słynnemu komputerowi Macintosh. Interakcja z maszyną stała się symboliczna - okna, ikony, menu i różne sposoby wybierania treści sprawiły, że nauka obsługi komputera stała się znacznie bardziej dostępna dla społeczeństwa.

Były to narodziny masowych produktów komputerowych, prawdziwy początek ery cyfrowej. Niezależnie od tego, czy jesteś studentem programowania czy po prostu głodnym wiedzy czytelnikiem, mamy nadzieję, że ten artykuł odpowiedział na niektóre z Twoich pytań. Jeśli chcesz zdobyć praktyczne umiejętności pracy z komputerem, przeczytaj rtykuł o Facebooku lub wyszukaj kurs excel Warszawa na Superprof.

Era sztucznej inteligencji – nowy etap w historii komputerów

Sztuczna inteligencja (AI) wyrasta bezpośrednio z ewolucji komputerów, łącząc idee Alana Turinga z 1936 r. (test Turinga i maszyna uniwersalna) z rosnącą mocą obliczeniową. Lata 50. przyniosły perceptrony, czyli pierwsze sieci neuronowe, a dekady później algorytmy uczenia maszynowego. Przełomem stał się 30. listopada 2022 r., gdy OpenAI uruchomiło ChatGPT, pierwszy LLM dostępny dla mas, demokratyzując AI w codziennym życiu.

Dziś, w 2026 r., AI napędza rozwój komputerów jak nigdy – od asystentów głosowych po generowanie treści i autonomiczne systemy. To kulminacja okresu zapoczątkowanego pojawieniem się komputerów: od mechanicznych wirników Enigmy, przez architekturę von Neumanna, po chmurowe klastry GPU. Przyszłość? To m.in. hybrydowe systemy człowiek-maszyna, gdzie AI wspiera kreatywność, np. w ekologicznym marketingu. A co jeszcze? Poczekamy, zobaczymy.

Podsumuj za pomocą AI